原文中文,约1600字,阅读约需4分钟。

📝

内容提要

阿里云发布并开源了推理模型千问QwQ-32B,其性能与DeepSeek-R1相当,支持在消费级显卡上本地部署。该模型通过大规模强化学习提升了数学和编程能力,适合高安全性应用。用户可免费下载体验,未来将探索智能体与强化学习的结合。

🎯

关键要点

-

阿里云发布并开源推理模型千问QwQ-32B,性能与DeepSeek-R1相当。

-

千问QwQ-32B通过大规模强化学习提升数学和编程能力,适合高安全性应用。

-

该模型支持在消费级显卡上本地部署,降低了使用成本。

-

用户可免费下载体验千问QwQ-32B,未来将探索智能体与强化学习的结合。

-

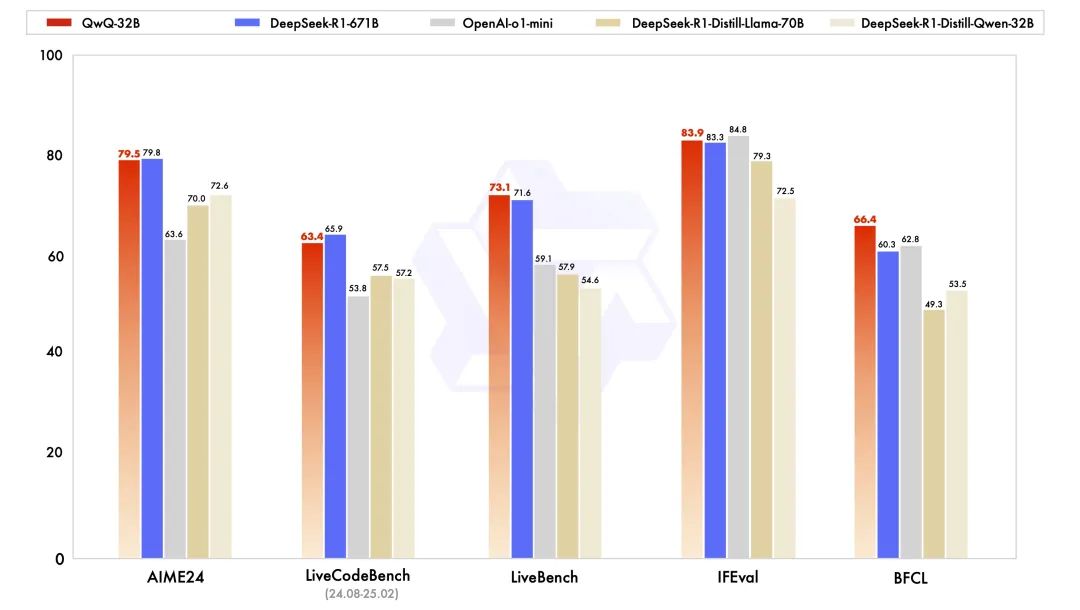

千问QwQ-32B在多项权威基准测试中表现出色,超越OpenAI-o1-mini。

-

模型集成了与智能体Agent相关的能力,能够进行批判性思考。

-

用户可通过阿里云PAI平台快速部署模型,或选择容器服务实现高效推理。

-

通义团队已开源200多款模型,成为全球最大的开源模型族群。

❓

延伸问答

通义千问QwQ-32B模型的主要特点是什么?

通义千问QwQ-32B模型通过大规模强化学习提升了数学和编程能力,性能与DeepSeek-R1相当,支持在消费级显卡上本地部署。

如何获取通义千问QwQ-32B模型?

用户可以通过阿里云的开源平台免费下载通义千问QwQ-32B模型,使用Apache2.0协议进行商用。

通义千问QwQ-32B模型适合哪些应用场景?

该模型适合高安全性应用,能够在消费级硬件上快速响应,满足数据安全要求。

通义千问QwQ-32B与其他模型相比有什么优势?

在多项权威基准测试中,千问QwQ-32B表现超越OpenAI-o1-mini,并与DeepSeek-R1相当,显示出更强的推理能力。

通义千问QwQ-32B模型的部署方式有哪些?

用户可以选择在消费级显卡上本地部署,或通过阿里云PAI平台进行云端快速部署和微调。

未来通义团队对千问QwQ-32B模型有什么计划?

通义团队计划继续探索智能体与强化学习的结合,以实现更高智能和长时推理的目标。

🏷️