💡

原文英文,约800词,阅读约需3分钟。

📝

内容提要

本文介绍了如何通过Langfuse提升大模型(LLM)和多智能体(Agents)的可观测性。Langfuse是一个开源平台,提供追踪功能,帮助开发者监控LLM的调用路径、响应时间和成本等关键指标。文章展示了Langfuse与OpenAI和Anthropic的集成案例,以及单智能体和多智能体的应用场景,从而优化LLM应用的稳定性和性能。

🎯

关键要点

- 本文介绍了如何使用Langfuse提升大模型(LLM)和多智能体(Agents)的可观测性。

- Langfuse是一个开源平台,提供追踪功能,帮助开发者监控LLM的调用路径、响应时间和成本等关键指标。

- Langfuse的主要特点包括高度可定制化、高效资源管理、完善的监控运维体系和多功能支持。

- Langfuse适用于构建生产级LLM应用,特别是在快速开发和优化自定义对话系统、机器翻译系统等场景。

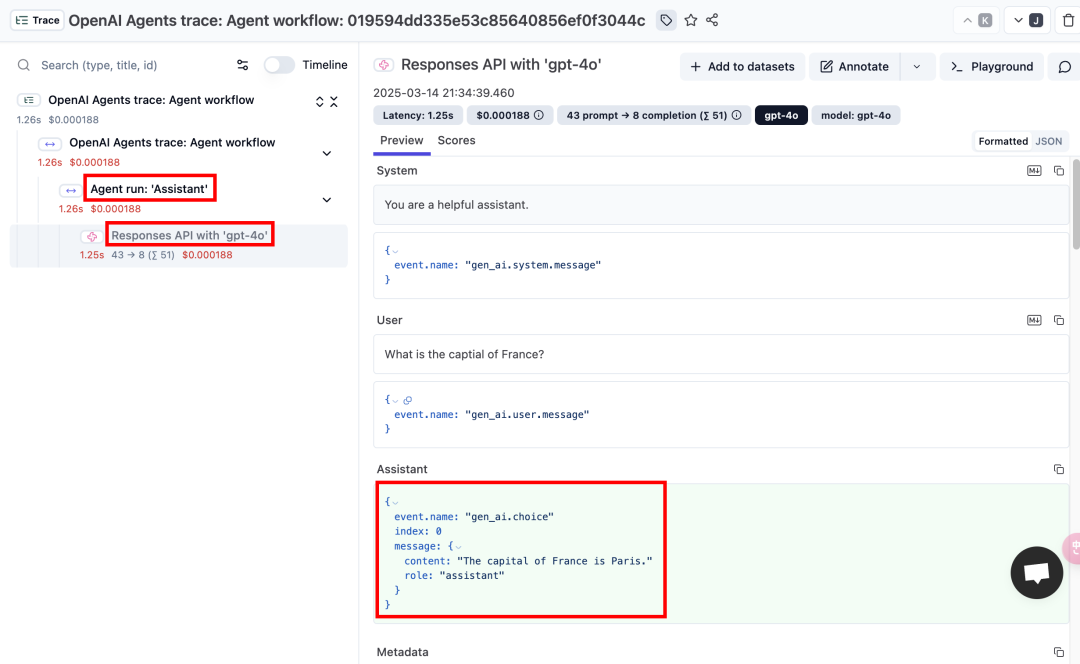

- Langfuse与OpenAI的集成示例展示了如何追踪LLM的响应情况与成本。

- Langfuse支持任意LLM的追踪能力,包括Anthropic的Claude系列模型。

- 用户可以自定义调用LLM的任务名称、trace_id和session_id等信息。

- Langfuse与OpenAI的Multi Agents框架结合使用,支持单智能体和多智能体的应用场景。

- 通过Langfuse,开发者可以清晰地跟踪智能体的决策路径、交互过程以及外部API的调用情况。

- Langfuse的功能强大,能够优化LLM应用的稳定性和性能,后续将继续探索其更多功能。

❓

延伸问答

Langfuse是什么,它的主要功能有哪些?

Langfuse是一个开源平台,旨在提升大模型(LLM)和多智能体(Agents)的可观测性,主要功能包括追踪LLM的调用路径、响应时间和成本等关键指标。

如何使用Langfuse监控LLM的性能?

使用Langfuse可以通过创建账号并设置环境变量,结合其提供的追踪功能,监控LLM的调用路径、响应时间和成本等性能指标。

Langfuse如何与OpenAI集成?

Langfuse与OpenAI的集成通过简单的代码实现,开发者可以使用Langfuse的装饰器来追踪OpenAI模型的响应情况和成本。

Langfuse支持哪些类型的智能体应用?

Langfuse支持单智能体和多智能体应用,能够帮助开发者清晰地跟踪智能体的决策路径和交互过程。

Langfuse的自定义配置功能有哪些?

Langfuse允许用户自定义调用LLM的任务名称、trace_id和session_id等信息,以满足不同的监控需求。

使用Langfuse可以优化LLM应用的哪些方面?

通过Langfuse,开发者可以优化LLM应用的稳定性和性能,提升监控和运维的效率。

➡️