💡

原文中文,约2900字,阅读约需7分钟。

📝

内容提要

豆包大模型推出四档思考长度调节功能,提高AI使用效率并降低企业成本。同时,新语音模型能准确朗读复杂公式,增强语音交互能力。火山引擎发布智能模型路由,自动选择最优模型以满足不同需求,推动AI行业发展。

🎯

关键要点

- 豆包大模型推出四档思考长度调节功能,提高AI使用效率并降低企业成本。

- 新语音模型能准确朗读复杂公式,增强语音交互能力。

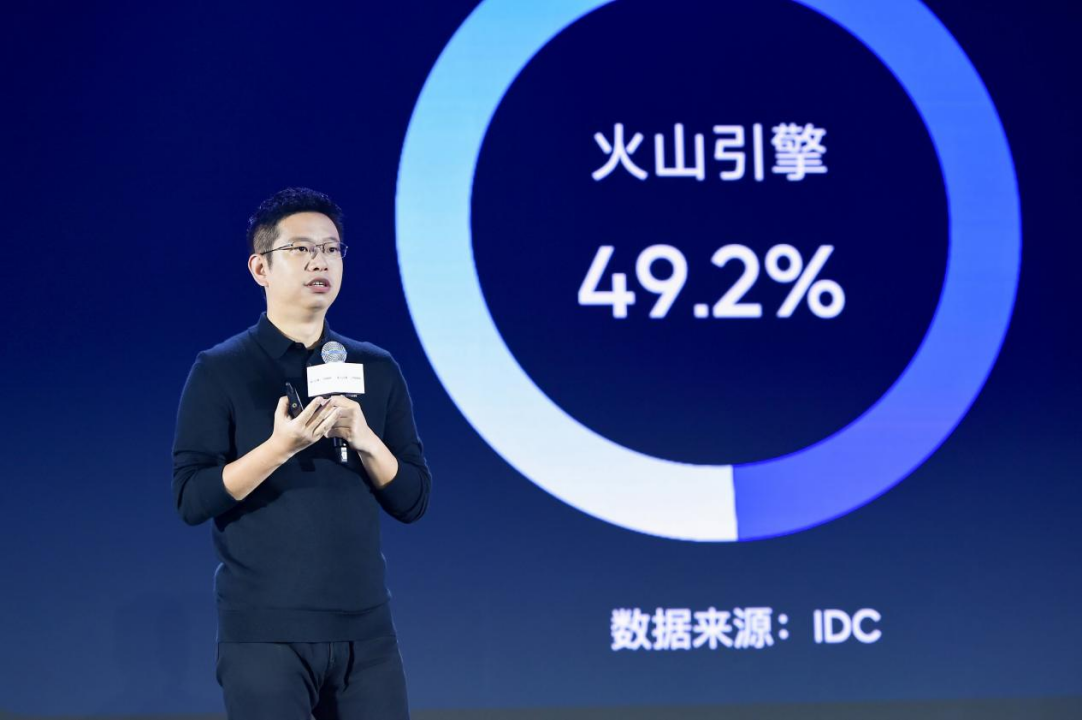

- 火山引擎发布智能模型路由,自动选择最优模型以满足不同需求。

- 深度思考模式能提升效果,但因延迟和成本问题,实际使用占比低。

- 豆包大模型1.6提供Minimal、Low、Medium、High四档思考长度,灵活平衡效果、时延和成本。

- 豆包大模型1.6 lite在成本和推理速度上有显著优势。

- 新语音模型在复杂公式朗读中准确率达到90%,解决教育场景中的难题。

- 智能模型路由支持多种模式,自动选择最合适的模型以满足不同任务需求。

- AI模型选择的智能化提升了整体行业的效率和成本效益。

- 技术迭代的最终目标是让用户用得起、更要用得好。

❓

延伸问答

豆包大模型1.6的思考长度调节功能有什么优势?

豆包大模型1.6提供Minimal、Low、Medium、High四档思考长度,企业可以根据场景灵活平衡效果、时延和成本,显著提高AI使用效率。

新语音模型在复杂公式朗读方面的表现如何?

新语音模型在复杂公式朗读中的准确率达到90%,解决了教育场景中的朗读难题。

火山引擎的智能模型路由功能有什么作用?

智能模型路由功能可以自动选择最合适的模型,以满足不同任务需求,提升整体效率和成本效益。

豆包大模型1.6 lite与旗舰款相比有什么优势?

豆包大模型1.6 lite在成本和推理速度上有显著优势,综合使用成本较豆包1.5 pro降低53.3%。

深度思考模式的实际使用占比是多少?

深度思考模式的实际使用占比只有18%,主要因为其延迟和成本问题。

豆包语音模型家族覆盖了哪些领域?

豆包语音模型家族覆盖语音合成、语音识别、声音复刻、实时语音、同声传译、音乐创作、播客创作等7大领域。

➡️