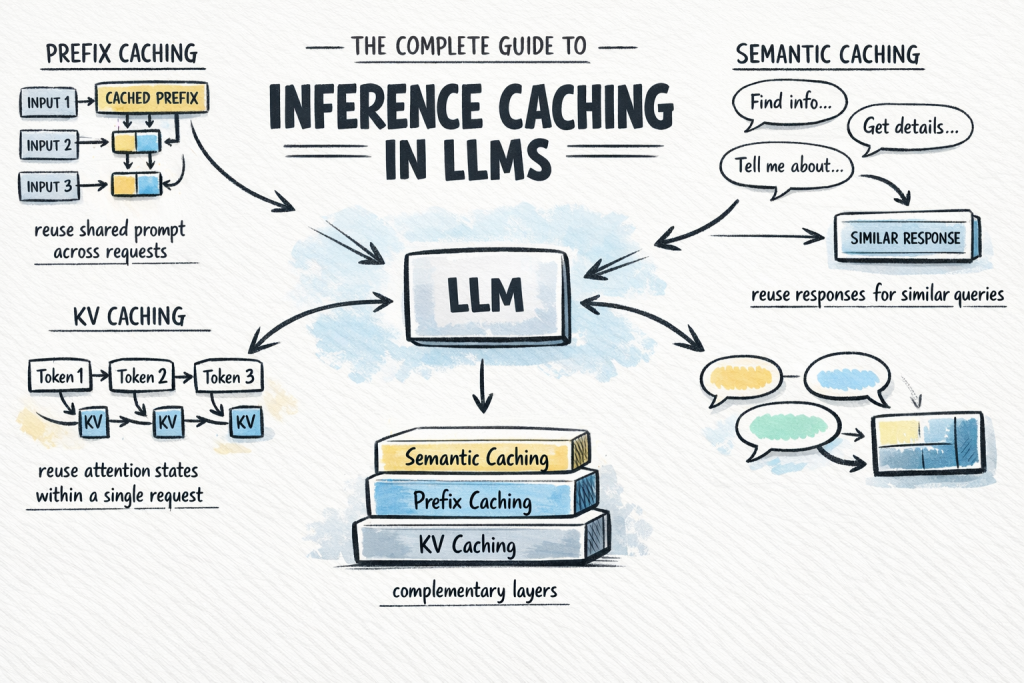

大语言模型推理缓存完整指南

MachineLearningMastery.com

·

通过强化学习优化键值缓存的驱逐策略

Apple Machine Learning Research

·

nanovllm-block_manager

plus studio

·

范围:优化长上下文生成中的键值缓存压缩

BriefGPT - AI 论文速递

·