💡

原文中文,约1700字,阅读约需4分钟。

📝

内容提要

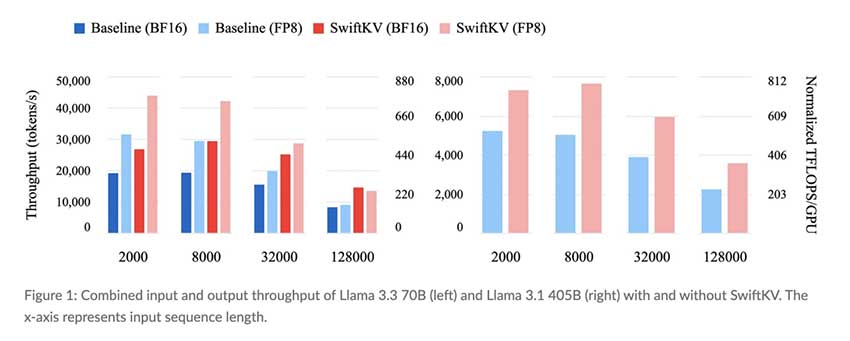

大型语言模型(LLM)在人工智能中至关重要,但其高计算成本和延迟限制了应用。Snowflake AI推出的SwiftKV通过键值缓存技术提高推理效率,降低成本,最高可减少75%。该技术与现有框架兼容,支持可持续的AI实践,促进LLM的广泛应用与创新。

🎯

关键要点

-

大型语言模型(LLM)在人工智能中至关重要,但高计算成本和延迟限制了其应用。

-

Snowflake AI推出的SwiftKV通过键值缓存技术提高推理效率,降低成本。

-

SwiftKV使用键值缓存技术重用中间计算,消除冗余计算,简化推理过程。

-

SwiftKV与现有LLM框架兼容,支持无缝集成,易于采用。

-

SwiftKV的优势包括降低成本、增强吞吐量、节能和可扩展性。

-

在某些情况下,SwiftKV可将推理成本降低高达75%,而不影响准确性或性能。

-

SwiftKV的开源特性鼓励AI社区的协作与创新。

-

SwiftKV为大规模部署LLM提供了有效解决方案,推动人工智能的可持续发展。

❓

延伸问答

SwiftKV是如何降低LLM推理成本的?

SwiftKV通过键值缓存技术重用中间计算,消除冗余计算,从而显著降低推理成本,最高可减少75%。

SwiftKV的主要优势是什么?

SwiftKV的主要优势包括降低成本、增强吞吐量、节能和可扩展性,适合大规模部署。

SwiftKV与现有的LLM框架兼容吗?

是的,SwiftKV与现有的LLM框架兼容,如Hugging Face的Transformers和Meta的LLaMA,便于无缝集成。

SwiftKV如何提高推理效率?

SwiftKV通过引入缓存层,识别和存储可重复使用的计算结果,从而加速推理并减少资源需求。

SwiftKV的开源特性有什么意义?

SwiftKV的开源特性鼓励AI社区的协作与创新,促进技术的共享和功能的增强。

使用SwiftKV对AI应用程序的影响是什么?

使用SwiftKV可以使AI应用程序更加实用和易于访问,解决高计算成本和延迟问题。

➡️