💡

原文中文,约1900字,阅读约需5分钟。

📝

内容提要

动态内存稀疏化(DMS)是一种高效的键值缓存压缩方法,能够在不降低模型精度的情况下提升推理性能。研究表明,DMS在多个基准测试中表现优异,实现了8倍的KV缓存压缩,同时保持或提高了模型性能,适合资源受限环境。

🎯

关键要点

- 动态内存稀疏化(DMS)是一种高效的键值缓存压缩方法,提升推理性能而不降低模型精度。

- DMS通过压缩键值缓存,解决了推理时间性能受限于内存占用的问题。

- 现有的键值缓存优化技术存在准确性损害或计算成本高昂的缺点。

- DMS采用混合方法,训练开销极小,使用延迟移除技术保留重要上下文信息。

- DMS使用基于Gumbel-Sigmoid的采样机制,使驱逐决策在训练过程中可微分。

- DMS在推理任务中实现了8倍的KV缓存压缩,同时保持或提高模型性能。

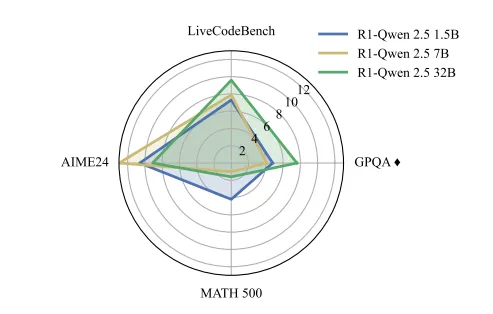

- 在多个基准测试中,DMS在不同模型大小下均表现优异,提升了精确匹配性能。

- DMS在非推理任务中也表现出色,保持性能的同时实现高达4倍的压缩率。

- DMS为基于Transformer的语言模型提供了一种实用且可扩展的解决方案,适合资源受限环境。

❓

延伸问答

动态内存稀疏化(DMS)是什么?

DMS是一种高效的键值缓存压缩方法,旨在提升推理性能而不降低模型精度。

DMS如何解决推理时间性能受限的问题?

DMS通过压缩键值缓存,减少内存占用,从而提升推理时间性能。

DMS与现有的键值缓存优化技术相比有什么优势?

DMS在保持模型性能的同时,实现了8倍的KV缓存压缩,且训练开销极小。

DMS在不同模型大小下的表现如何?

DMS在不同模型大小下的基准测试中均表现优异,提升了精确匹配性能。

DMS在非推理任务中的表现如何?

DMS在非推理任务中也表现出色,保持性能的同时实现高达4倍的压缩率。

DMS的核心技术是什么?

DMS使用基于Gumbel-Sigmoid的采样机制,使驱逐决策在训练过程中可微分。

➡️