SpecTokenizer:压缩频谱域的轻量级流式编解码器

实时互动网

·

wavlm-large模型onnx和mnn版本的导出与使用

Yunfeng's Simple Blog

·

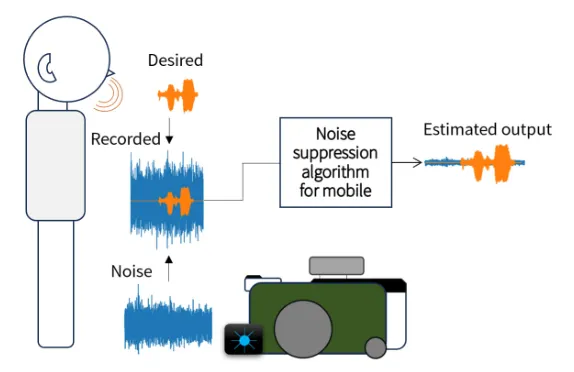

低复杂度降噪技术:助力扫地机器人实现高效实时语音处理

实时互动网

·

轻量级可信分布式聚类

BriefGPT - AI 论文速递

·

M2R2:多速率残差混合框架用于高效的变换器推理

Apple Machine Learning Research

·

寻找高效且成本低廉的初始化剪枝方法

BriefGPT - AI 论文速递

·

在多类分类环境中学习以提供支持

BriefGPT - AI 论文速递

·

静态嵌入:你应该关注吗?

Qdrant - Vector Database

·

联邦微调大语言模型:框架比较与研究方向

BriefGPT - AI 论文速递

·