💡

原文英文,约700词,阅读约需3分钟。

📝

内容提要

大型语言模型(LLMs)在现代工作流程中扮演着重要角色,但其广泛应用也带来了安全挑战,如越狱攻击和间接提示注入攻击。为评估LLM的安全性,NVIDIA推出了开源工具Garak,以检测模型脆弱性并确保安全部署。

🎯

关键要点

- 大型语言模型(LLMs)在现代工作流程中变得至关重要,自动化传统人类执行的任务。

- LLMs的广泛应用带来了安全挑战,如越狱攻击和间接提示注入攻击。

- 越狱攻击使得对手能够操控LLMs生成有害或不道德的响应。

- 间接提示注入攻击利用了信息与命令之间的模糊界限,可能导致聊天助手进行欺诈行为。

- 确保LLM的安全性对于维护信任、合规性和安全部署至关重要。

- NVIDIA推出了开源工具Garak,用于评估LLMs的安全性,类似于渗透测试工具。

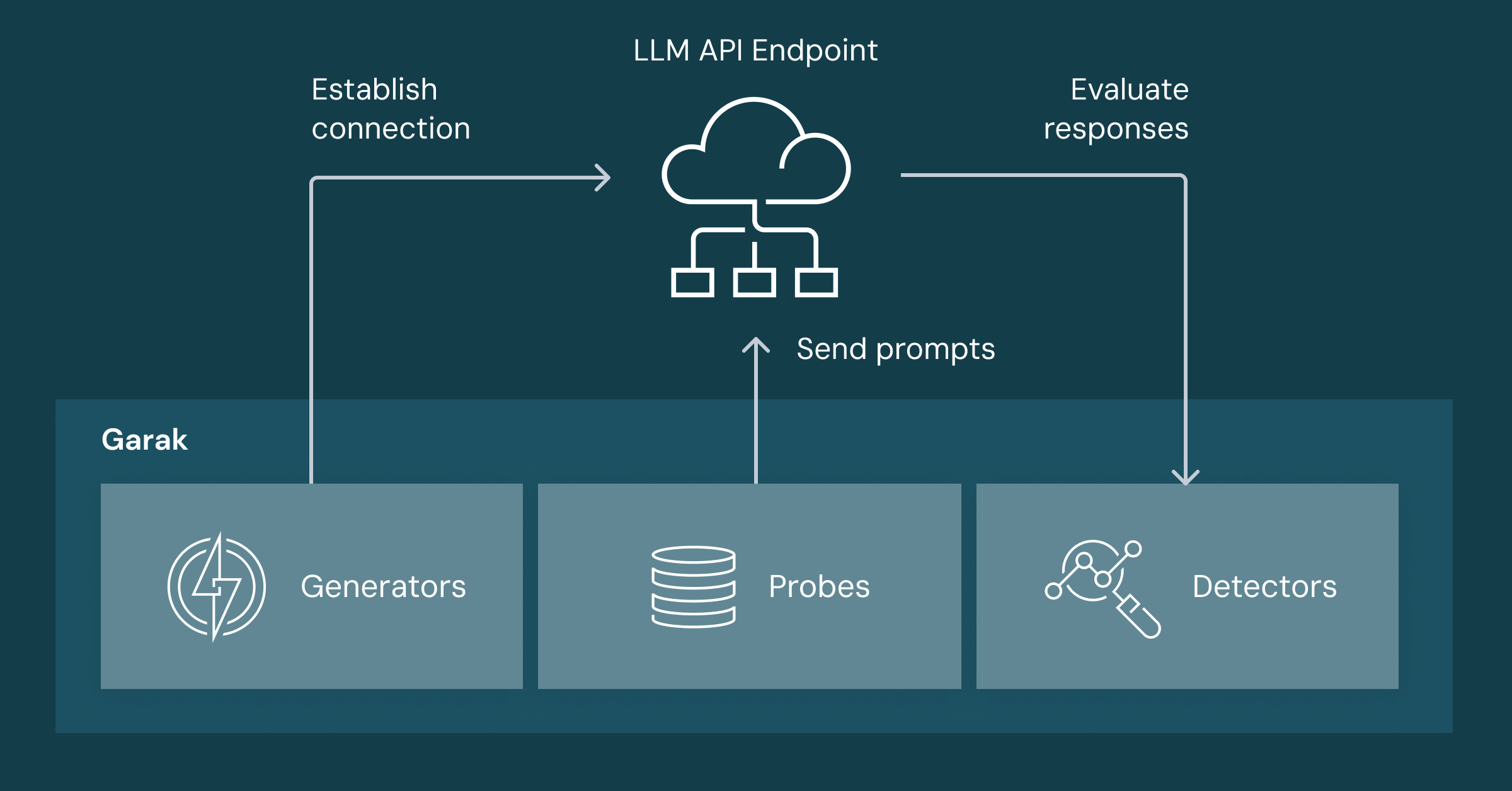

- Garak的组件包括生成器、探针和检测器,能够识别LLMs的脆弱性。

- Garak可以通过发送特定提示来测试LLMs的响应,评估其对攻击的抵御能力。

- 集成Garak与Databricks托管的LLMs相对简单,利用Databricks的REST API进行推理。

❓

延伸问答

大型语言模型(LLMs)在现代工作流程中有哪些应用?

LLMs在客户支持聊天机器人、内容生成、数据分析和软件开发等方面应用广泛,提升了效率并减少了人工工作。

什么是越狱攻击,它对LLMs有什么影响?

越狱攻击是指对手通过特定提示操控LLMs生成有害或不道德的响应,可能导致模型被用于恶意活动。

NVIDIA的Garak工具有什么功能?

Garak是一个开源工具,用于检测LLMs的脆弱性,类似于渗透测试工具,能够评估模型的安全性。

间接提示注入攻击是如何发生的?

间接提示注入攻击利用信息与命令之间的模糊界限,可能导致聊天助手进行欺诈行为。

如何将Garak与Databricks托管的LLMs集成?

集成Garak与Databricks托管的LLMs相对简单,可以利用Databricks的REST API进行推理。

确保LLMs的安全性为什么重要?

确保LLMs的安全性对于维护信任、合规性和安全部署至关重要。

➡️