💡

原文中文,约2600字,阅读约需6分钟。

📝

内容提要

在有限显存下,运行大型语言模型需平衡模型规模、量化精度和上下文长度。显存需求受模型参数、上下文缓存和系统开销影响,增加上下文长度会迅速消耗显存。选择合适的量化格式可提升性能。

🎯

关键要点

- 在有限显存下,运行大型语言模型需平衡模型规模、量化精度和上下文长度。

- 显存需求受模型参数、上下文缓存和系统开销影响,增加上下文长度会迅速消耗显存。

- 推理时显存需求计算公式为:显存需求 = (模型总参数量 * 量化密度) + 上下文缓存 + 系统开销。

- 系统开销通常在1GB到3GB之间,主要用于存储激活值、显存Buffer和计算Buffer。

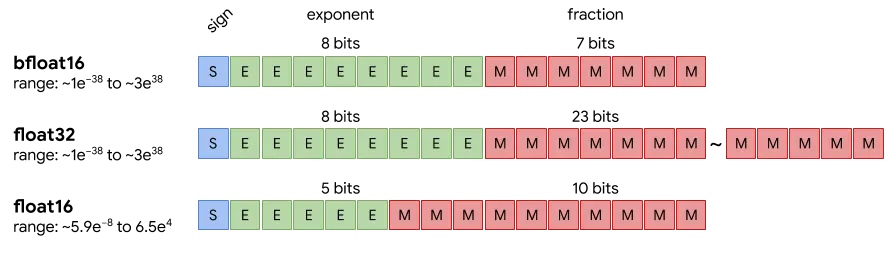

- 量化密度影响每个参数占用的空间,BF16、Q8、Q4等不同精度对应不同的显存需求。

- 上下文缓存随着输入和输出文本长度变化,计算公式为:上下文缓存 ≈ 2 * 模型的层数 * 上下文长度 * 批处理大小 * 隐藏层维度 * 缓存精度。

- 上下文长度越长,占用的显存越多,8GB显存在上下文长度设置到32k或64k时会爆满。

- BF16是大型语言模型训练的主流精度,能够在保证数值范围的同时减少内存和速度需求。

- 量化格式选择建议:追求极致效果用BF16/FP16,最佳平衡点从Q4_K_M或Q5_K_M开始尝试。

- 在有限显存下,需要在模型规模、量化精度和上下文长度之间进行动态权衡。

❓

延伸问答

如何计算推理时的显存需求?

推理时显存需求计算公式为:显存需求 = (模型总参数量 * 量化密度) + 上下文缓存 + 系统开销。

上下文长度对显存的影响是什么?

上下文长度越长,占用的显存越多,增加上下文长度会迅速消耗显存。

在有限显存下,如何选择量化格式?

建议追求极致效果用BF16/FP16,最佳平衡点从Q4_K_M或Q5_K_M开始尝试。

系统开销通常是多少?

系统开销通常在1GB到3GB之间,主要用于存储激活值、显存Buffer和计算Buffer。

量化密度如何影响显存需求?

量化密度影响每个参数占用的空间,不同精度对应不同的显存需求,例如BF16、Q8、Q4等。

在选择模型时需要考虑哪些因素?

需要在模型规模、量化精度和上下文长度之间进行动态权衡,以适应有限显存的条件。

➡️