💡

原文中文,约1600字,阅读约需4分钟。

📝

内容提要

Meta 发布的 MobileLLM 是一组高效的小型语言模型,旨在优化移动设备的部署,减少对云资源的依赖。通过深而薄的架构和多项创新技术,MobileLLM 提供了竞争力的性能,降低了延迟和能耗。在零样本任务中表现优于同类模型,展现了在聊天和 API 调用等应用中的潜力。

🎯

关键要点

- Meta 发布了 MobileLLM,一组高效的小型语言模型,旨在优化移动设备的部署。

- MobileLLM 减少了对云资源的依赖,降低了延迟和能耗。

- 该模型在零样本任务中表现优于同类模型,展现了在聊天和 API 调用中的潜力。

- MobileLLM 提供了不同大小的模型检查点:125M、350M、600M 和 1B 参数。

- 模型采用深而薄的架构,专注于深度而非宽度,增强了捕捉抽象概念的能力。

- 关键创新包括嵌入共享、分组查询注意和即时块级权重共享,提升了模型效率。

- MobileLLM 在 API 调用任务中表现出与较大模型相当的精确匹配分数。

- 该模型为解决大规模 LLM 的计算和环境成本问题提供了创新的解决方案。

- MobileLLM 代表了将 LLM 功能引入移动设备的重要一步,保持高性能并降低运营成本。

❓

延伸问答

MobileLLM 的主要目标是什么?

MobileLLM 的主要目标是优化移动设备上的语言模型部署,减少对云资源的依赖。

MobileLLM 有哪些不同大小的模型检查点?

MobileLLM 提供了 125M、350M、600M 和 1B 四种不同大小的模型检查点。

MobileLLM 如何降低延迟和能耗?

MobileLLM 通过深而薄的架构和多项创新技术,如嵌入共享和分组查询注意,降低了延迟和能耗。

MobileLLM 在零样本任务中的表现如何?

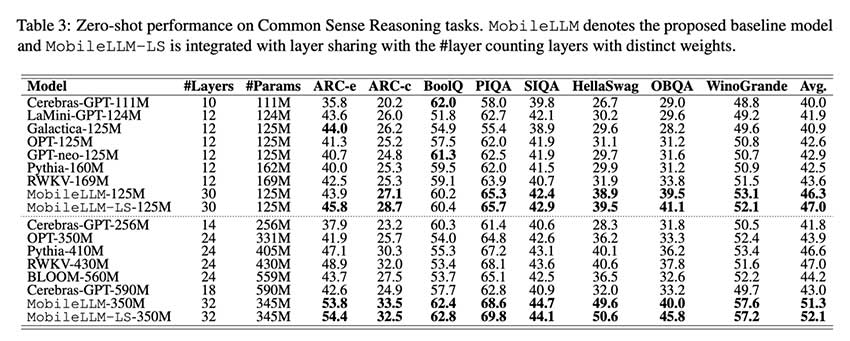

在零样本任务中,MobileLLM 的表现优于同类模型,125M 模型比 350M 模型高出 2.7%。

MobileLLM 的关键创新技术有哪些?

MobileLLM 的关键创新包括嵌入共享、分组查询注意和即时块级权重共享,这些技术提升了模型效率。

MobileLLM 如何与大型模型相比?

尽管尺寸较小,MobileLLM 在 API 调用任务中实现了与较大模型相当的精确匹配分数,展示了其竞争力。

➡️