💡

原文中文,约1800字,阅读约需5分钟。

📝

内容提要

多模态大型语言模型(MLLM)正在迅速发展,能够同时处理文本和视觉数据。研究人员提出的OLA-VLM方法通过嵌入优化提升视觉理解,显著提高了模型在视觉任务中的表现,且在效率和性能上优于现有模型,为未来多模态系统的发展奠定了基础。

🎯

关键要点

- 多模态大型语言模型(MLLM)能够同时处理文本和视觉数据,具有变革性的应用。

- 当前MLLM面临的核心挑战是依赖自然语言监督进行训练,导致视觉表现质量不佳。

- 现有方法在计算效率和性能改进之间需要取得平衡,限制了可扩展性和实用性。

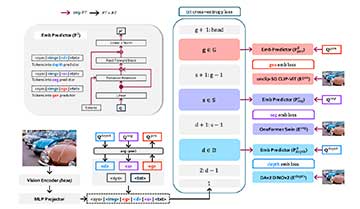

- 研究人员提出的OLA-VLM方法通过嵌入优化提升视觉理解,改进了MLLM的性能。

- OLA-VLM在预训练期间将辅助视觉信息提炼到隐藏层中,不增加视觉编码器的复杂性。

- 该方法在视觉推理中确保更好的性能,而无需增加额外的计算开销。

- OLA-VLM在各种基准测试中表现优异,尤其在深度估计和分割任务中显著提高了准确率。

- 研究表明,特殊的任务特定标记有助于优化视觉特征,提升下游任务性能。

- OLA-VLM为将视觉信息集成到MLLM中建立了新标准,展示了嵌入优化的有效性。

- 该研究突出了多模态AI的突破性进展,为未来更强大、更可扩展的多模态系统铺平了道路。

❓

延伸问答

OLA-VLM方法的主要创新点是什么?

OLA-VLM通过嵌入优化提升视觉理解,改进了多模态大型语言模型的性能,而不增加视觉编码器的复杂性。

多模态大型语言模型面临哪些主要挑战?

主要挑战是依赖自然语言监督进行训练,导致视觉表现质量不佳,以及在计算效率和性能改进之间的平衡问题。

OLA-VLM在视觉推理任务中的表现如何?

OLA-VLM在视觉推理任务中表现优异,特别是在深度估计和分割任务中显著提高了准确率。

如何提高多模态大型语言模型的计算效率?

通过在预训练期间将辅助视觉信息提炼到隐藏层中,OLA-VLM确保更好的视觉推理而无需增加计算开销。

特殊的任务特定标记在OLA-VLM中有什么作用?

特殊的任务特定标记有助于优化视觉特征,提升下游任务的性能,确保视觉信息有效集成。

OLA-VLM与现有模型相比有哪些优势?

OLA-VLM在性能和效率上优于现有单编码器和多编码器模型,尤其在视觉任务中表现显著提升。

➡️