💡

原文中文,约1800字,阅读约需5分钟。

📝

内容提要

Meta AI推出了感知语言模型(PLM),这是一个开放且可复现的视觉语言建模框架,支持图像和视频输入。PLM通过合成数据和人工标记数据进行训练,强调透明性和可评估性,集成了视觉编码器和不同参数的语言解码器,采用多阶段训练流程。PLM发布了两个高质量视频数据集,支持细粒度视频理解,并在多个基准测试中表现优异,推动了多模态人工智能研究。

🎯

关键要点

- Meta AI推出了感知语言模型(PLM),这是一个开放且可复现的视觉语言建模框架。

- PLM支持图像和视频输入,强调透明性和可评估性。

- 模型通过合成数据和人工标记数据进行训练,集成了视觉编码器和不同参数的语言解码器。

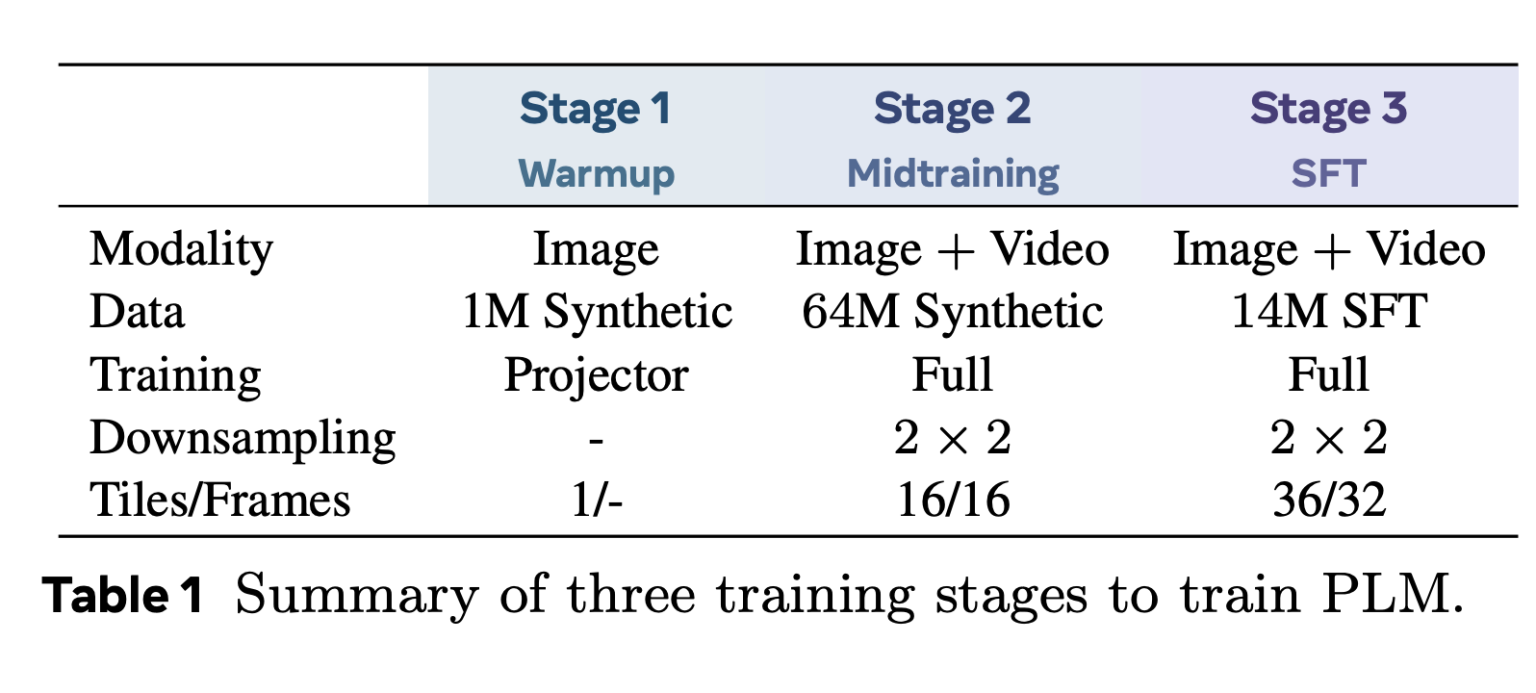

- PLM采用多阶段训练流程,确保训练稳定性和可扩展性。

- 发布了两个高质量视频数据集,PLM-FGQA和PLM-STC,支持细粒度视频理解。

- PLM采用模块化架构,支持高分辨率图像和多帧视频输入。

- Meta AI推出了PLM-VideoBench,评估视频理解方面的基准测试集。

- PLM在多个图像和视频基准测试中表现优异,尤其在视频字幕生成方面提升显著。

- PLM提供了一个方法论严谨且完全开放的框架,旨在推动多模态人工智能研究。

❓

延伸问答

感知语言模型(PLM)是什么?

感知语言模型(PLM)是Meta AI推出的一个开放且可复现的视觉语言建模框架,支持图像和视频输入。

PLM是如何进行训练的?

PLM通过合成数据和人工标记数据进行训练,采用多阶段训练流程,确保训练稳定性和可扩展性。

PLM发布了哪些数据集?

PLM发布了两个高质量视频数据集:PLM-FGQA和PLM-STC,支持细粒度视频理解。

PLM在视频理解方面的表现如何?

PLM在多个图像和视频基准测试中表现优异,尤其在视频字幕生成方面提升显著,平均比开放基线模型提升了39.8 CIDEr。

PLM的模块化架构有什么特点?

PLM采用模块化架构,支持高分辨率图像和多帧视频输入,能够处理复杂的视觉任务。

PLM-VideoBench是什么?

PLM-VideoBench是Meta AI推出的一个新的基准测试集,旨在评估视频理解方面的任务。

➡️